小米在2023年底正式发布小米SU7,成为继华为之后第二个推出成品的的科技企业。不过此时小米需要做的不仅是打造一款产品力够高的车型,更是要以后发者的身份更快速地追上头部智驾车企。从昨天的发布会中可以发现,小米SU7采用双Orin-X芯片以及27个感知硬件组合,这套硬件组合在业界属于主流方案,小米在智能驾驶的技术创新几乎全在软件方面。

从发布会流出的信息来看,小米自研的智能驾驶技术创新点集中在感知、决策方面。虽然都是使用BEV大模型+占用网络方案,小米的创新点在于通过超分辨率技术实现感知精度的提升,并且提升BEV大模型的感知范围与精度。实质上,小米则是加强了Orin-X芯片的AI处理份额占比,用AI超分辨率计算做高精度感知。超分辨率占用网络,高精度得益于算法更新

在这次发布会中,小米公布了其智能驾驶感知模型为BEV+占用网络方案,小米的方案与小鹏、理想的感知模型相同,都是通过感知硬件获取周围空间模型的思路。但小米却加入了变焦BEV+超分辨率占用网络方案,占用网络模型精度有了不小的提升。

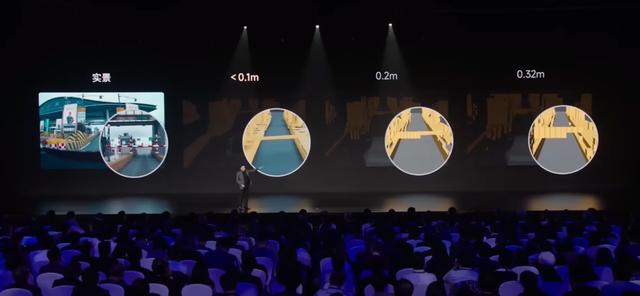

雷军在发布会上提到,小米的超分辨率占用网络模型精度达到了小于0.1m的水平,而特斯拉FSD的占用网络精度则为0.32m,国内智驾方案达到了0.2m。在模型精度方面,小米比特斯拉方案实现了3倍以上的提升幅度,着实让人很是惊讶。

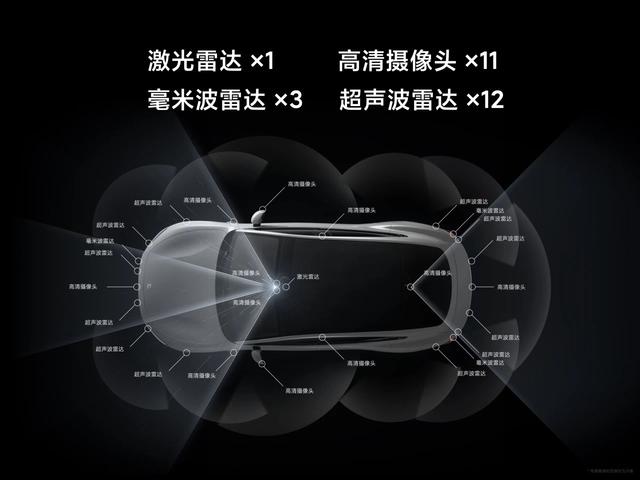

但在硬件方面,小米使用的感知硬件从规模到硬件水平并没有质的提升。感知硬件规模方面,小米SU7上的感知硬件总量为27个,分别为1颗激光雷达、3颗毫米波雷达、11个高清摄像头与12个超声波雷达。前几日发布的问界M9上,也采用了1颗激光雷达、3颗毫米波雷达、12个超声波雷达的方案,发布会上虽然未公布具体摄像头数量,但大概率还是使用11个摄像头方案。小米智能驾驶方案与华为ADS2.0的感知硬件规模相同,这也侧面证明了小米在智能驾驶硬件选择方面更偏向成熟化的主流方案。

同样,小米SU7上使用的一体式激光雷达,硬件方面依旧为主流的128线雷达,根据153万点云/秒的数据与200米探测距离,大概率使用的是禾赛AT128(与理想L9上的那颗相同)。再加上小米SU7使用的双英伟达Orin-X智驾芯片方案,硬件方面的性能水平与华为、理想、小鹏几乎无差别。

那么小米是如何做到更高精度的呢?这方面得益于小米活用了基于NAS的图像超分辨率技术,来自于小米AI团队。小米的图像超分辨率技术流程为提取特征、非线性映射和重建,即通过现有低分辨率图像中提取目标物体的特征,之后用AI对特征映射、重建高分辨率图像。小米的超分辨率AI模型使用了深度卷积神经网络,优化了图片生成速度与多目标还原,从而生成更高质量的模型,比当前最优的超分辨率方法更快。在FLTOPS算力相当的前提下,深度卷积神经网络的超分辨率生成速度与效果都优于其他方法,或许这也是超分辨率技术能够上车的原因之一。